- 投稿日:2026/04/02

こんにちは、まーです!

こんにちは、まーです!

前回は「AIを3つ同時に動かしてチーム制作する方法」を紹介しました。

今回は、そのチームに「品質管理担当」を追加した話です。

AIの最大の弱点は「もっともらしいウソ」

AIが書いた文章って、読んでみると自然で、数字もそれっぽくて、つい「合ってるだろう」と思ってしまうんですよね。

でもこれが一番怖いんです。明らかなデタラメなら気づけるけど、「もっともらしいウソ」は人間が読んでも素通りしてしまう。

僕も最初は「AIが書いたんだから大丈夫でしょ」と思っていた時期がありました。

実際にあった「もっともらしいウソ」3選

僕のYouTubeチャンネルの台本で、AIが書いた内容をチェックしたら、こんなのが見つかりました。

僕のYouTubeチャンネルの台本で、AIが書いた内容をチェックしたら、こんなのが見つかりました。

①「A社の製品はB社の半額以下で買える」→ 実際に公式価格を調べたら6〜7割程度の価格だった。「半額以下」は完全に誇張。

②「湿度を10%台まで下げられる」→ メーカーの公式スペックにそんな数字はどこにも載っていなかった。ユーザー報告では20〜30%程度。

③「この機能はSTEP形式でしか使えない」→ 実際にはSTL形式でも使えた。精度は落ちるけど「使えない」は誤り。

どれも文脈に自然に溶け込んでいて、普通に読んだら「そうなんだ」で流してしまうレベルなんですよね。もしこのまま公開していたら、視聴者やリスナーに間違った情報を届けてしまうところでした。

Claude Codeに「ファクトチェック担当」を任せる

僕はClaude Codeにファクトチェック用のスキルを設定していて、コマンドを1つ打つだけで台本全体のチェックが走ります。

僕はClaude Codeにファクトチェック用のスキルを設定していて、コマンドを1つ打つだけで台本全体のチェックが走ります。

すると、台本の中の数字や比較表現を1つずつ拾って、Webの最新情報や公式ソースと照合してくれるんです。結果はレポート形式で返ってきます。

①「正確」─ ソースと一致。修正不要

②「要修正」─ 誇張やニュアンス違い。表現を調整

③「誤り」─ 事実と異なる。修正必須

さっきの3つの例も、全部このチェックで見つかったものです。自分で読み返しても気づけなかったものばかりでした。

全部チェックするのと、怪しいポイントだけチェックするのは全然違う

もちろん、AIのファクトチェックも完璧じゃないです。最終確認は必ず自分の目でやります。

もちろん、AIのファクトチェックも完璧じゃないです。最終確認は必ず自分の目でやります。

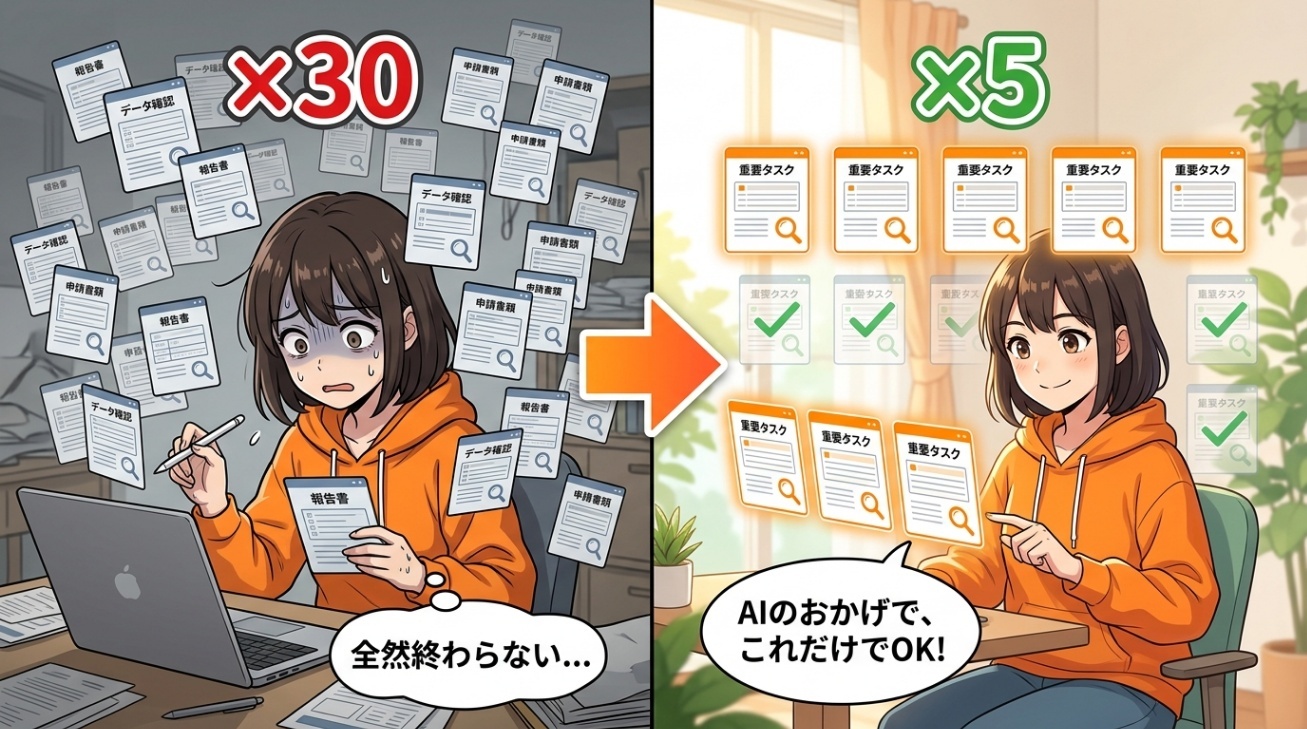

でも「全部の数字を自分で検索して裏取りする」のと、「AIが怪しいポイントを絞り込んでくれた上でチェックする」のでは、負担が全然違うんですよね。

台本1本あたりの主張が30個あるとして、そのうち25個は正確。残り5個だけ「ここ、ちょっと怪しいです」と教えてくれる。人間はその5個に集中すればいい。

AIを信頼するために、AIにチェックさせる

「AI任せは不安」という気持ち、すごくわかります。

「AI任せは不安」という気持ち、すごくわかります。

でも、不安だからこそ「チェックする工程もAIに任せる」という発想があってもいいんじゃないかと思うんです。書く担当と、チェックする担当を分ける。会社なら当たり前のことを、AIの世界でもやるだけです。

前回の「並列で3つ同時に動かす」話と組み合わせると、「書く担当」「チェックする担当」「画像を作る担当」のように役割分担ができる。1人なのに、品質管理までついたチームが回せるんですよね。

Claude Coworkでも、1つのチャットで「この文章を書いて」、もう1つのチャットで「この文章の事実関係をチェックして」と頼めば同じ考え方が使えるので、ぜひ試してみてください。

では、また次回。